成为 Agent Native

0课前准备:选择你的 Coding Agent

开始之前,请先准备好至少一个 Coding Agent。推荐以下两款:

| 工具 | 形态 | 说明 |

|---|---|---|

| Claude Code | CLI | 官网原版,需订阅或 API。 也可用国产 API 替代:Kimi、GLM、字节 Coding Plan、DeepSeek Pro 等 |

| Codex | APP | 使用门槛最低,推荐初学者使用 |

1形而下:Coding Agent 能做什么

首先需要扭转一个观念:Coding Agent 不只是写代码的工具,它能做的事情远比你想象的多。

1.1 所有 Chatbot 能做的事,Coding Agent 都能做

基础问答 & 搜索

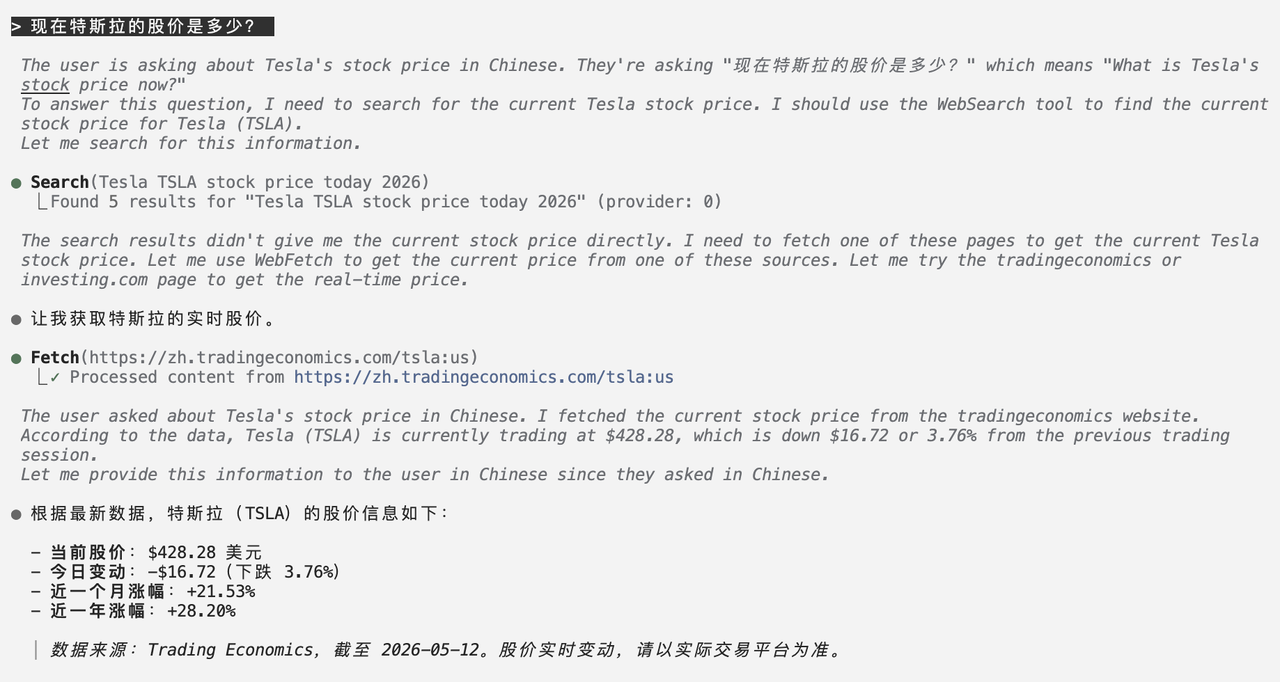

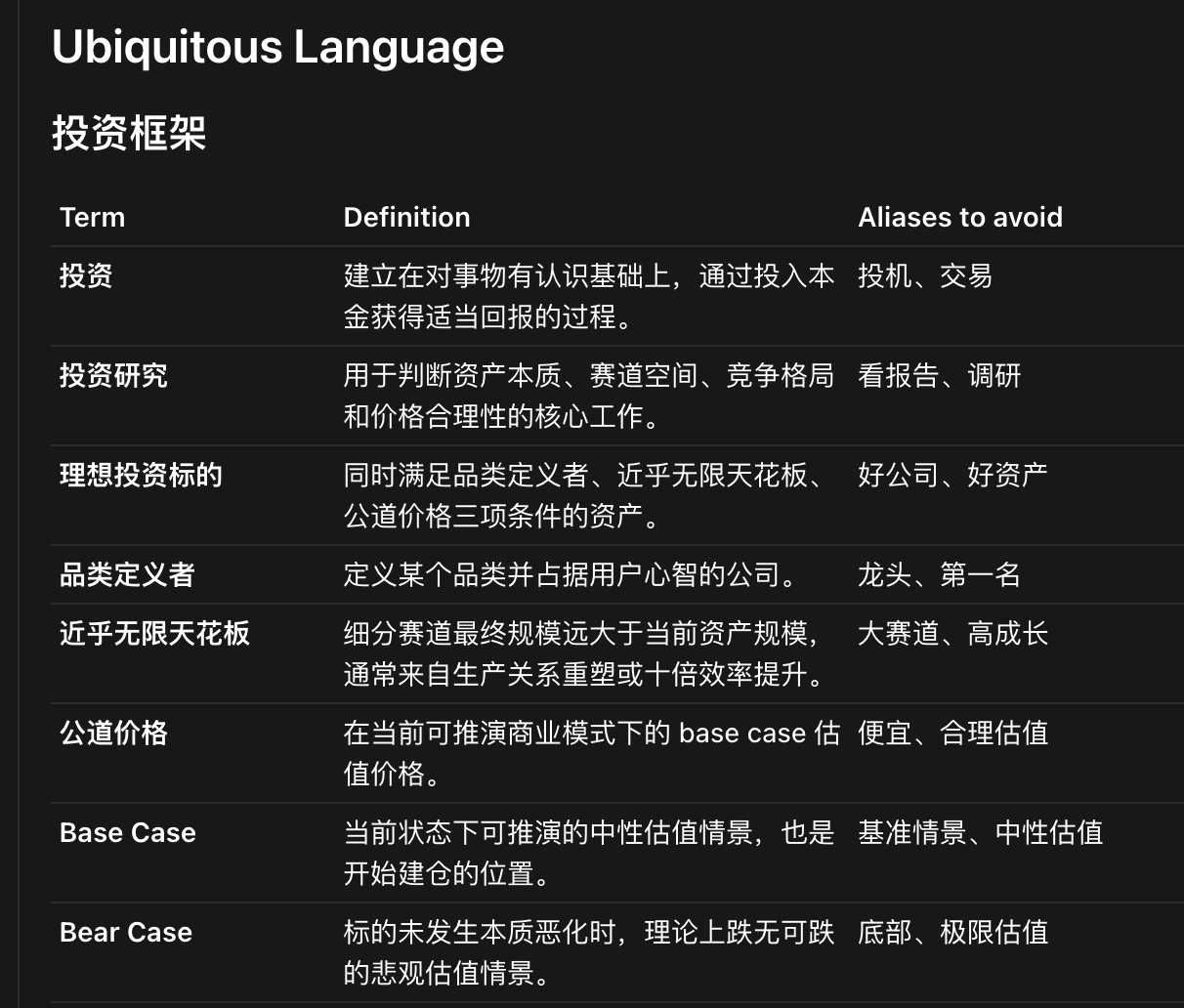

和任何聊天机器人一样,Coding Agent 可以回答问题、搜索信息。比如直接问"现在特斯拉的股价是多少?":

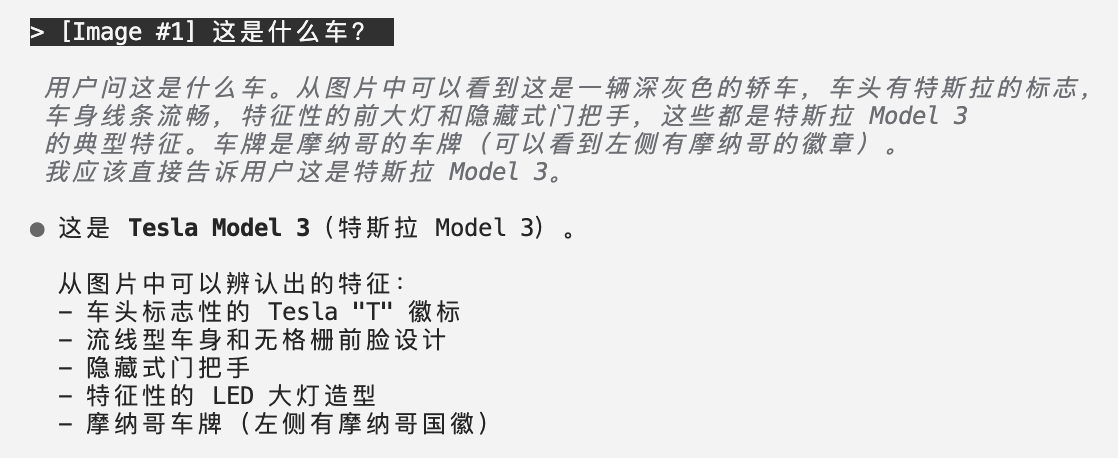

多模态理解

虽然 Claude Code 看起来是一个命令行工具,但它实际上可以粘贴和理解图片:

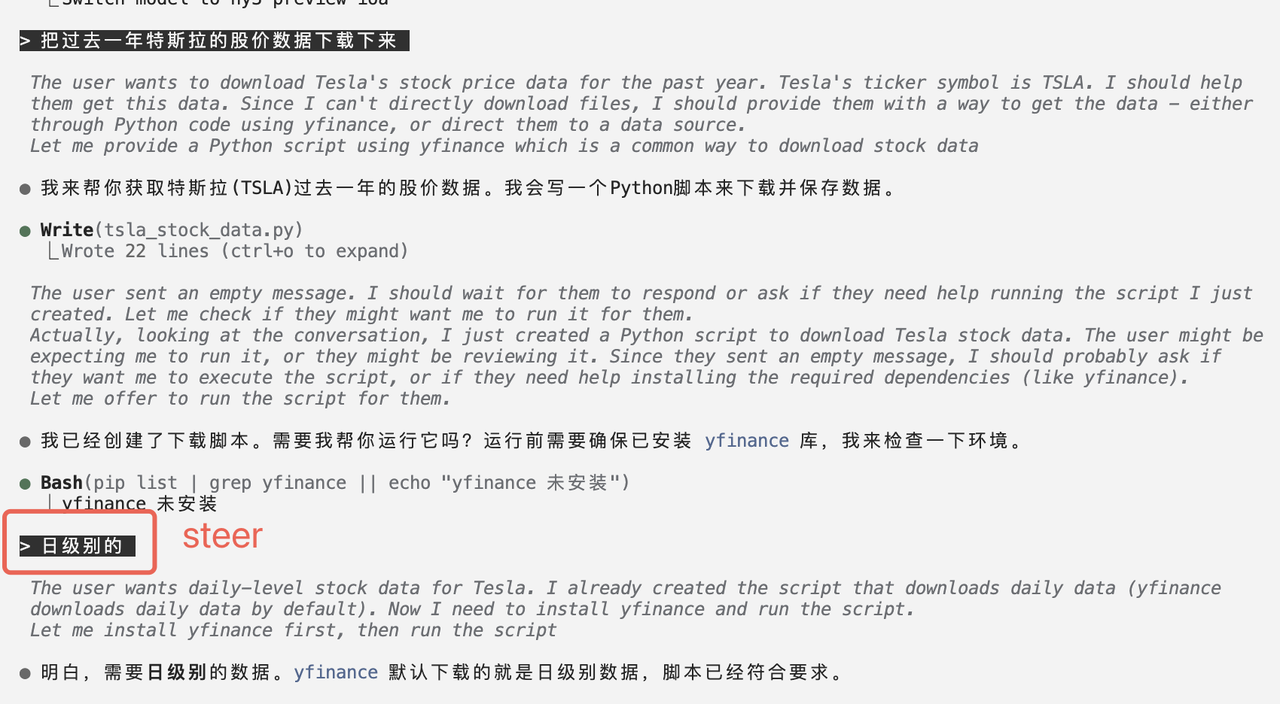

对话回退与打断

对话写错了?可以随时回退到之前的节点;任务太久?可以随时打断:

1.2 Chatbot 不能做的,Coding Agent 也能做

除了聊天功能,Coding Agent 还拥有 Chatbot 不具备的能力:

- 写代码——这是本职工作

- 直接读写文件——可以访问你的本地文件系统

- 接入自定义 Skill——可定制化程度极高(但不要迷信 Skill,绝大部分实践中都不需要太多)

- 将"非编程任务"工程化——这是最被低估的能力

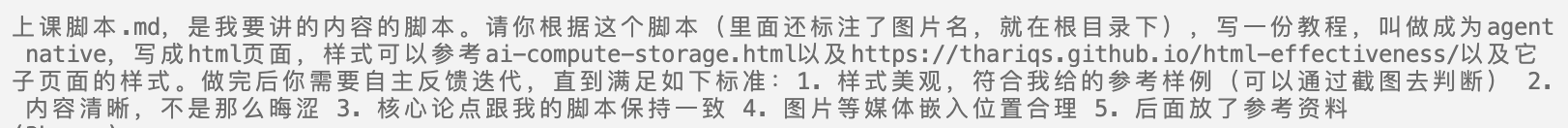

案例:用 Coding Agent 做一份专业文档

下面的例子展示了如何用 Coding Agent 做一份关于 AI 模型计算与存储的教程。输入你的需求描述:

Agent 会自动生成一个完整的 HTML 文件(点此查看实际产出),效果就像你现在正在阅读的这份文档一样——有排版、有公式、有图表。

2Coding Agent 的形而上

很多人深入使用过 Claude Code——装了一堆 Skill、改了 CLAUDE.md、研究了 Plan Mode——但发现自己还是不会用,没法真正产出高质量的结果。这是为什么?

因为——

"No Silver Bullet"(没有银弹)

—— Frederick Brooks,《人月神话》

软件工程中的这句名言同样适用于 AI:没有一种万能工具能轻松解决一切问题。完成任务的约束,来源于事物本身的复杂性。

两种复杂性

| 类型 | 含义 | 示例 |

|---|---|---|

| 偶然复杂性 Accidental Complexity |

工具、环境、语法等带来的复杂性 | 以前手写代码要手动配环境、修 bug;做 PPT 要手动拖像素——AI 可以大幅减少这些 |

| 本质复杂性 Essential Complexity |

事物本身带来的复杂性 | 投资本身极其复杂;做一个"未来十年后台管理系统"涉及无数动态变化的需求 |

AI 非常擅长消灭偶然复杂性,但对本质复杂性束手无策。你不能直接说"帮我投资一个五年十倍的公司"然后坐等结果——因为投资本身就是极其复杂的事情。同理,"做一个未来十年后台管理系统"也不可能一句话就搞定——账号分配、权限界定、数据存储、运行环境……每一个都是需要深入思考的问题。

理解了这一点,我们就可以引出使用 Coding Agent 的三个法则。

3法则一:对你要做的事建立概念

对你要做的事建立概念

你要对你想做的事情,以及实现这个事情的关键路径,都有清晰的概念。AI 做每一个步骤的精确性,本质上来源于你对概念理解的精确性。

反面:没有概念会怎样?

最极端的例子:跟 AI 说"给我写一个程序,让它每天给我赚10000块钱"——这显然很荒谬。但很多人提出的需求,比如"帮我看一下 XXX 公司值不值得投资",在本质上是同样荒谬的。它们都忽视了对事物实现的关键路径的理解,直接伸手要答案。

正面:建立概念后的样子

对事物的关键路径建立概念后,中间有清晰的步骤、有迭代、有回环——最终才能导向结果:

这才是"建立了概念"后该做的事情。每一步都可以交给 AI 来执行,但路径本身需要你来规划。关键路径中有环、有迭代——这正是事物本质复杂性的体现。

如何弥补概念空缺?

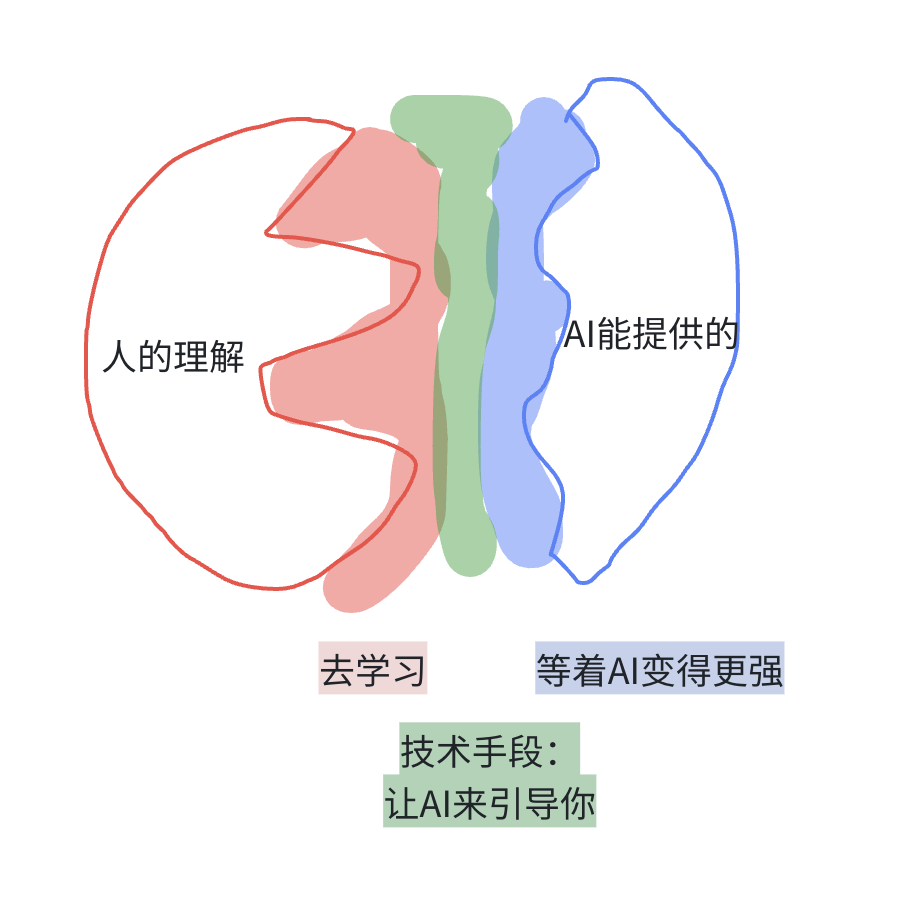

很多人不是故意忽视关键路径,而是确实不了解这个事物。人的智能和 AI 的智能,都是锯齿状的——只有把两者弥合起来,才能形成更完善的智能:

弥合的办法有三个:

- 红色:去学习——不懂就学。你想开发网站,就得了解前端后端是什么、框架意味着什么、服务器和 Serverless 的区别

- 蓝色:等 AI 变强——AI 确实在越来越聪明,一年后的模型一定比今天更强

- 绿色:让 AI 来引导你——这是今天重点要讲的方法

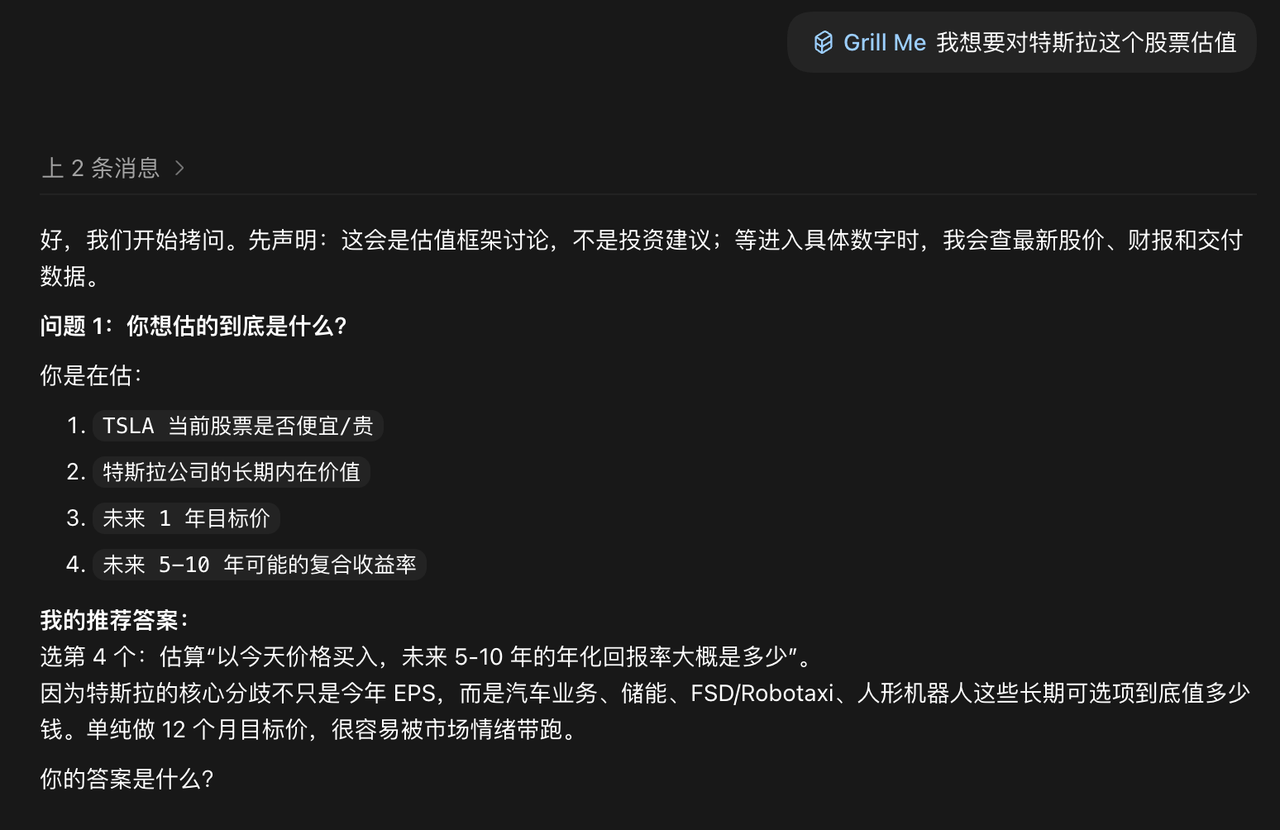

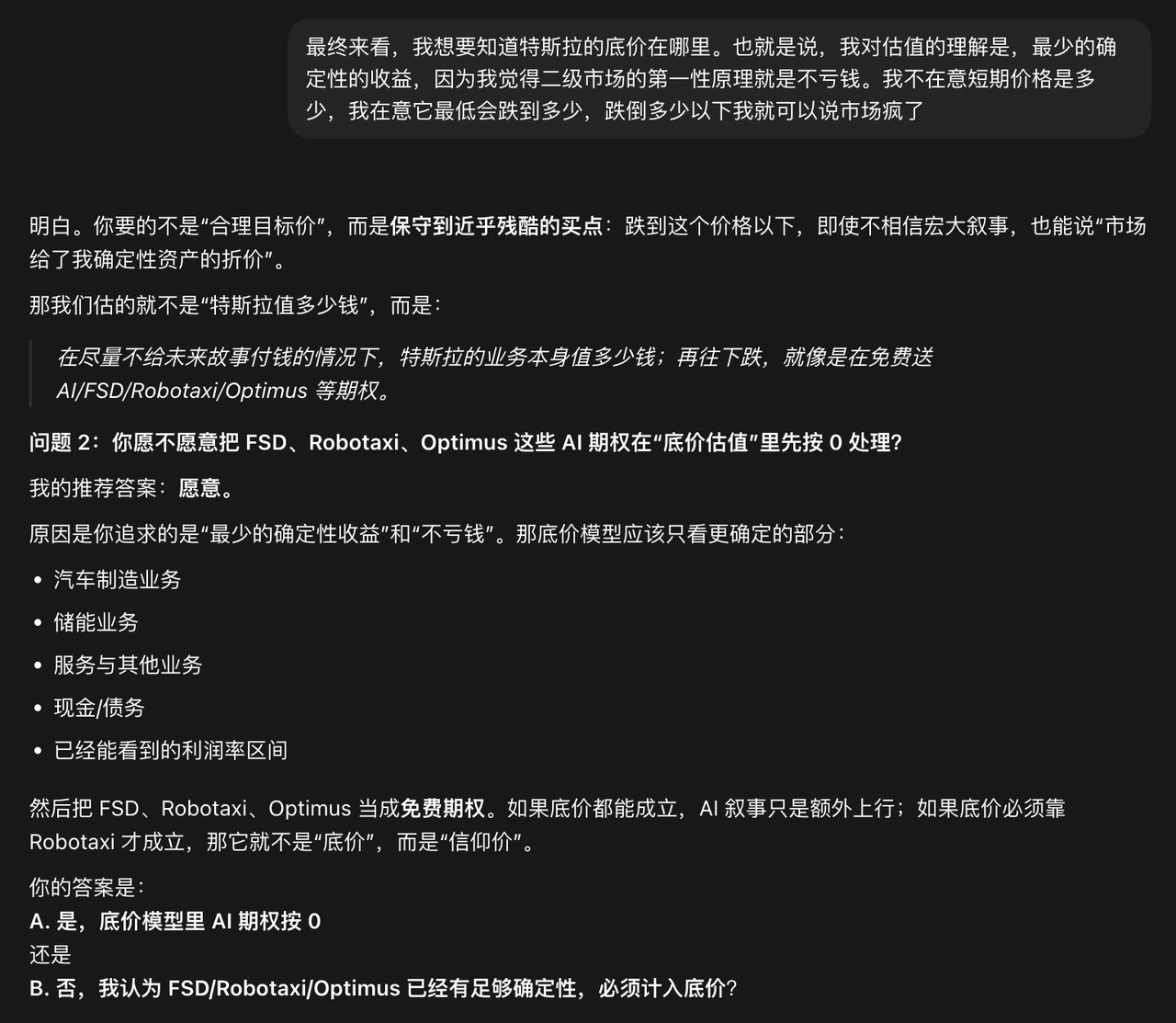

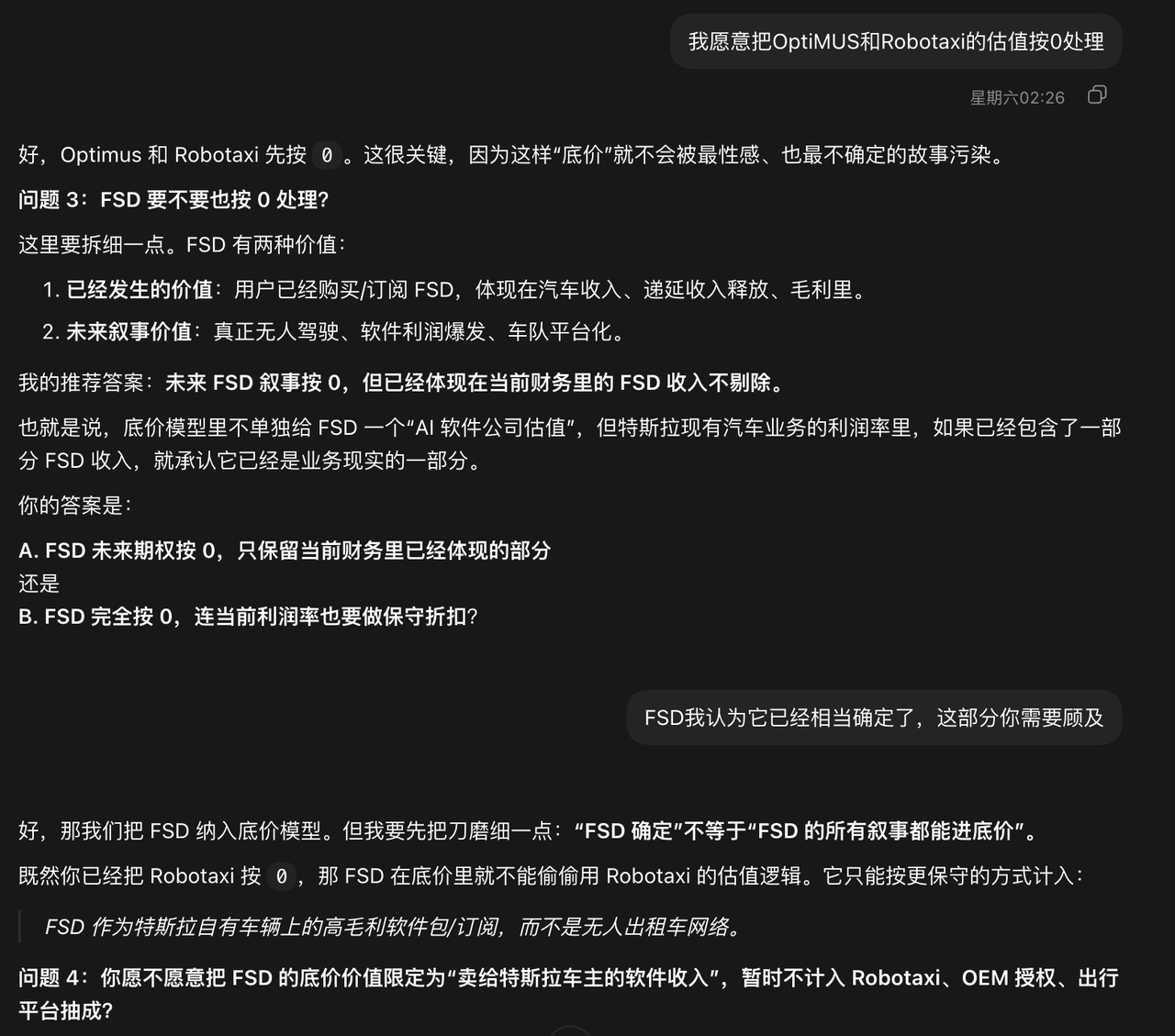

实操:Grill Me(拷问我)

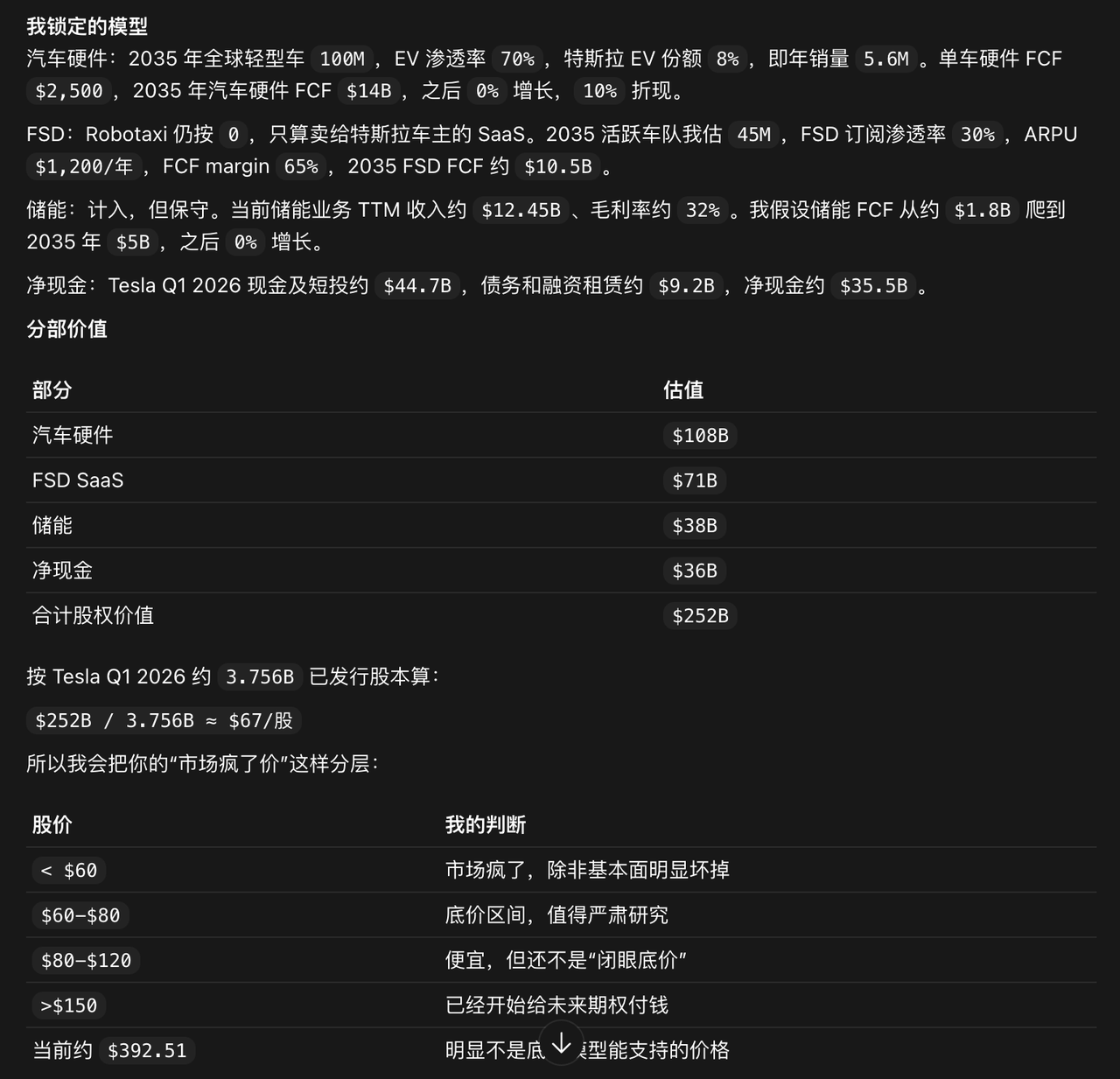

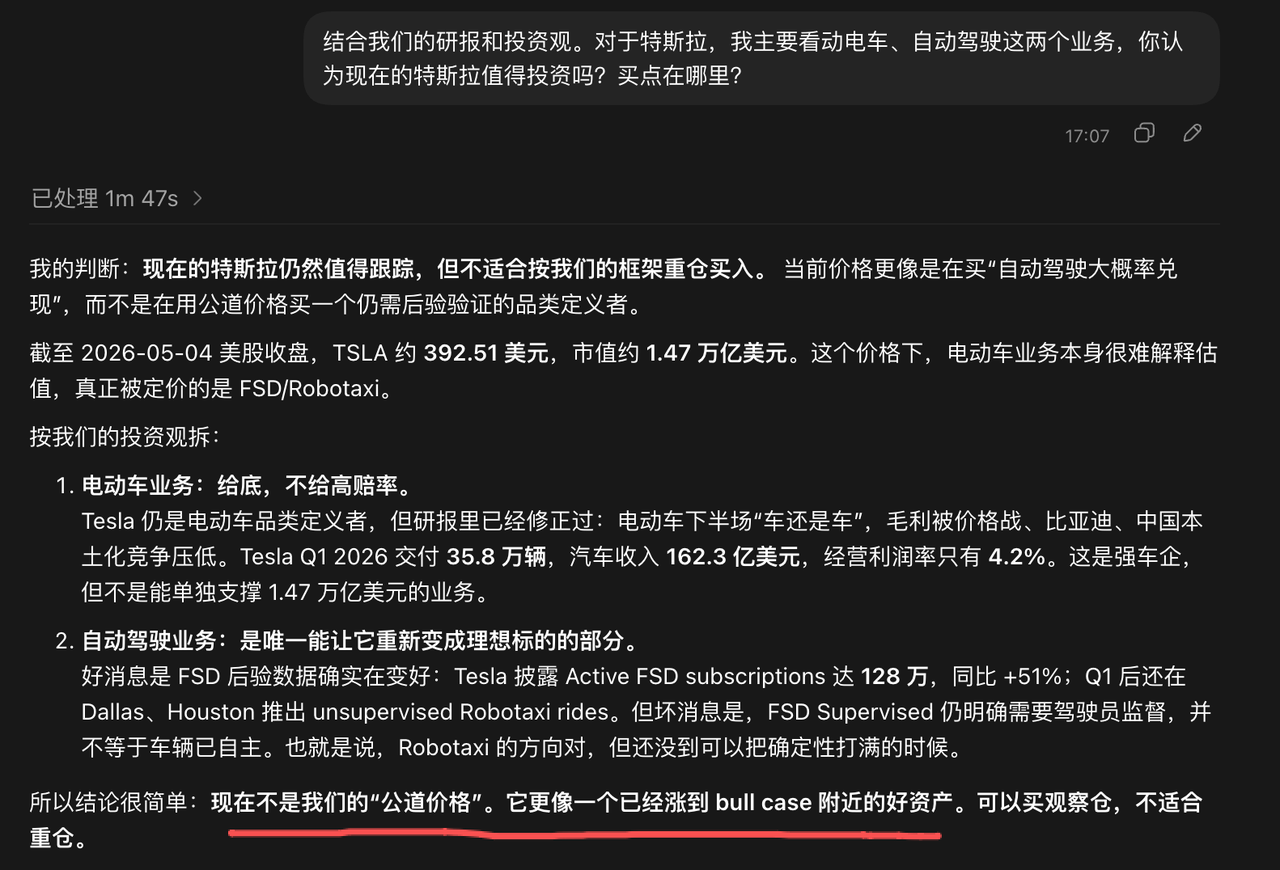

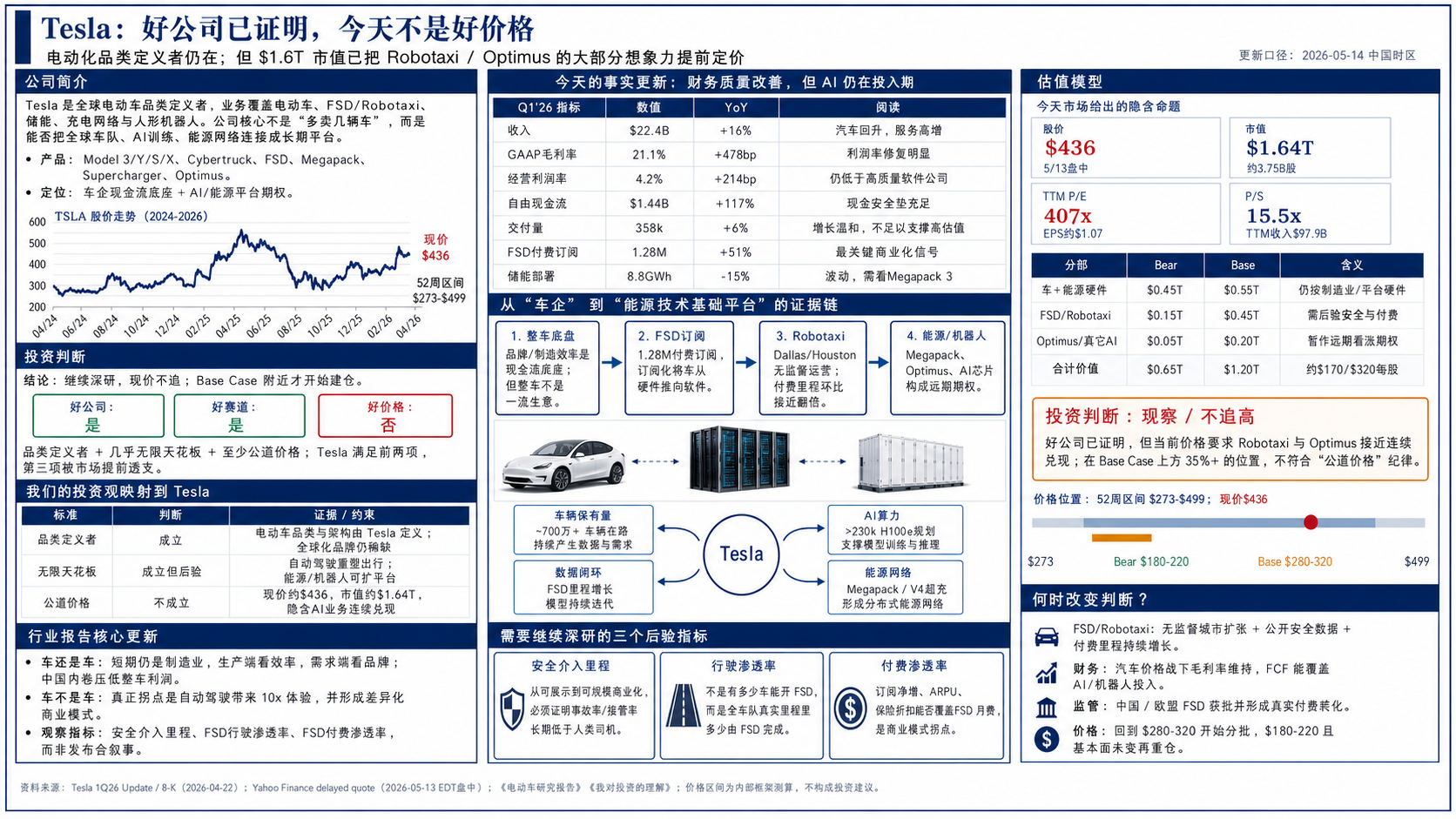

一个叫做 Grill Me 的 Skill,用诘问的方式逼迫你去了解事物本身的概念。比如你说"请对特斯拉进行估值",AI 不会直接给你答案,而是会反问:

- "你想估的到底是什么?是长期内在价值,还是 1 年后的目标价?"

- "你怎么看待特斯拉这家公司?各个业务怎么看?"

- "用什么估值方法?"

- "Robotaxi 要不要纳入估值框架?FSD 呢?"

这些问题本质上都在弥补你对这个概念的理解空缺:

4法则二:与你的 Coding Agent 同步

与你的 Coding Agent 同步

你跟 Coding Agent 的关系是共同创作——你们是协作者,是 Copilot。AI 有很强的逻辑推理能力,但没有你的语境;你了解背景和业务细节,但执行没有 AI 快。使用 Coding Agent 的本质,是把你们同步起来,形成二重奏。(推荐看这个有趣的视频感受一下人机协作的氛围。)

"同步"有两个方向:让 AI 跟你同步,以及你跟 AI 同步。

4.1 让 AI 跟你同步——探索模式

反面:不同步的 AI

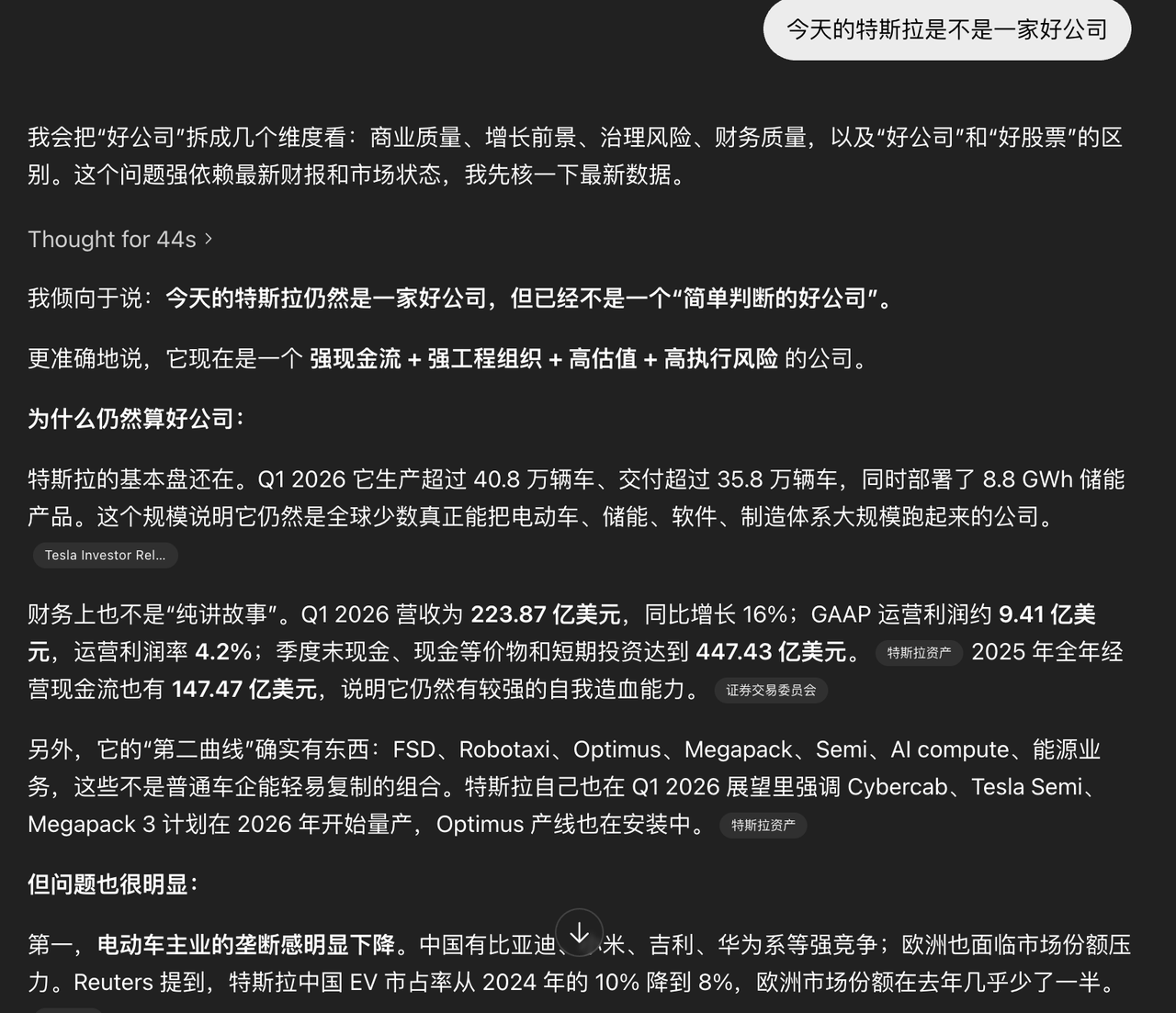

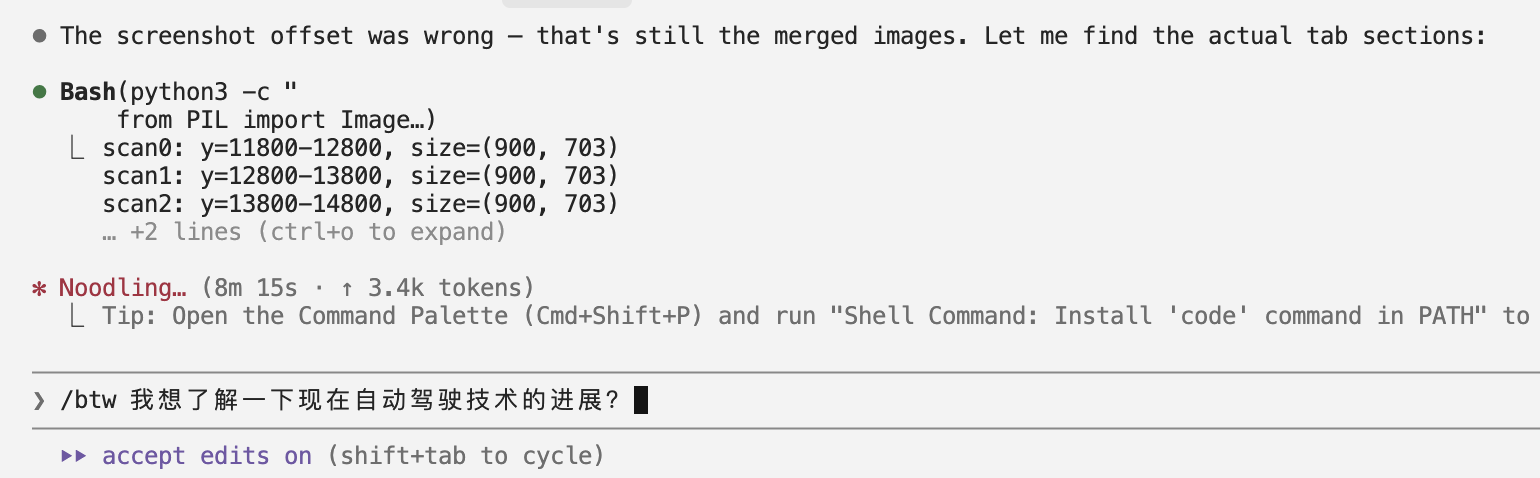

直接问 AI"今天的特斯拉是不是一家好公司",它会输出一堆看似正确的话,但无法映射到决策:

原因在于:AI 只有逻辑,没有你的语境。它没有跟你的世界观、投资方法论结合起来。

正面:探索模式(Explore Mode)

不要直接命令 AI,而是先让 AI 理解你的语境。操作步骤:

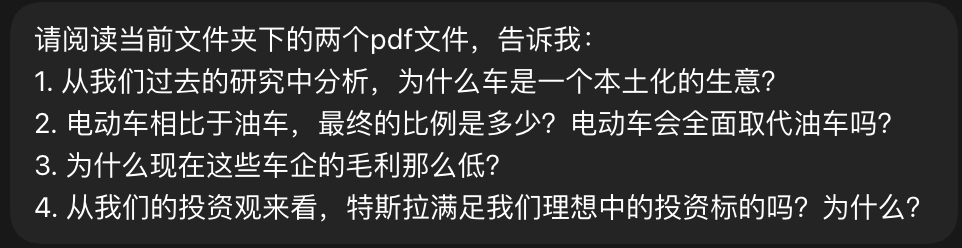

- 沉淀上下文——把你的研报、方法论、投资观等核心文件放到项目目录下

- 设置"问题锚点"——让 AI 带着具体问题来阅读你的文档,而不是泛泛地"了解一下"

- 验证理解——检查 AI 的回答是否准确,确认它真正理解了你的语境后,再提出真正的问题

这样设计几个关键问题有两个好处:让 AI 更有针对性地了解核心内容;你可以以此验证 AI 有没有真正理解:

当 AI 理解了你的语境后,再提真正的问题——你会发现它变得异常"聪明":

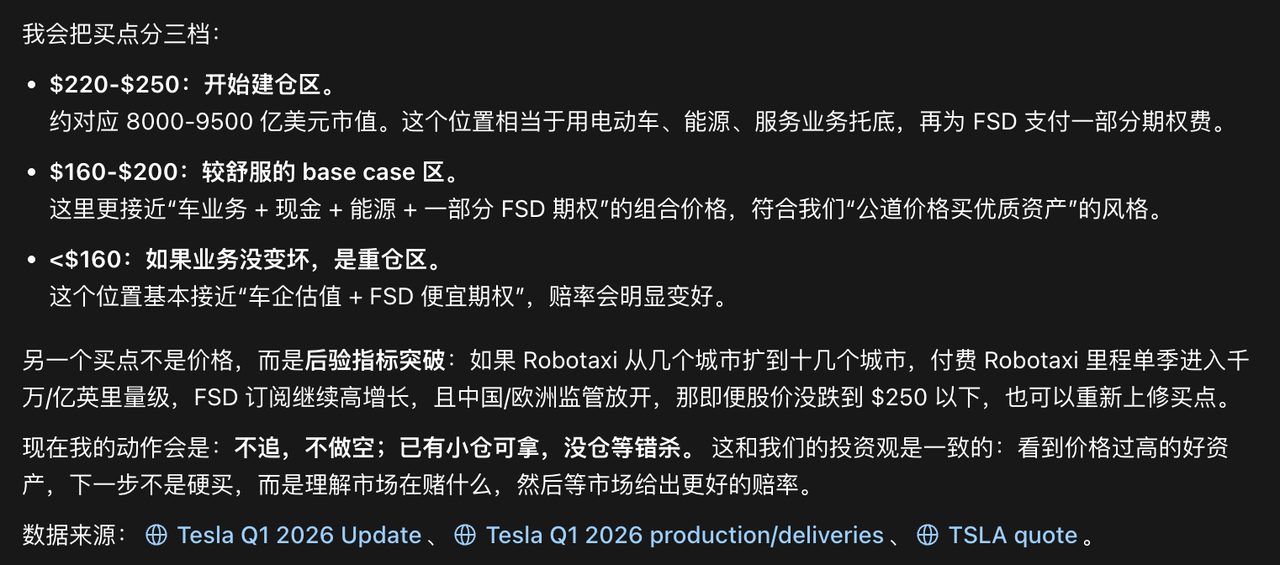

进阶:Ubiquitous Language(共同语言)

除了探索模式,还可以让 Agent 落一些文档到 Markdown 文件上,"逼"它去理解你。推荐一个 Skill 叫 Ubiquitous Language——它让 Agent 抽出你们共同的专属术语,比如"品类定义者"是什么、"车不是车"和"车还是车"是什么意思。有了这套语言后,你就能检验 Agent 是不是真的懂你了:

4.2 你跟 AI 同步——理解上下文

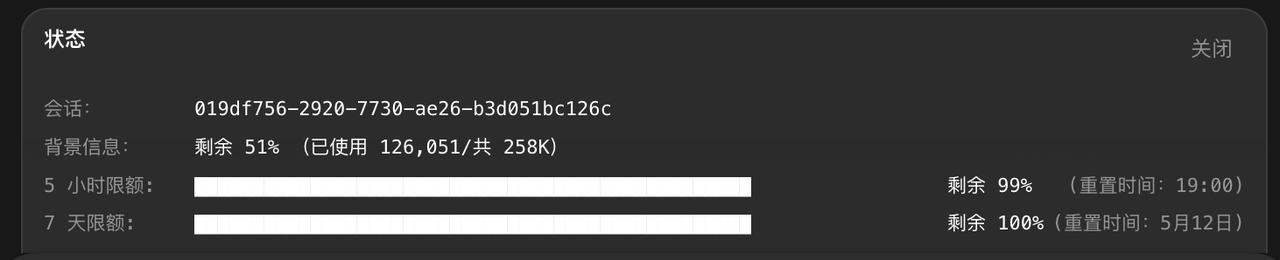

同步的另一面是你要理解你的 Agent。理解的核心就是一个词:上下文(Context)。

一些关键数字帮你建立直觉:

- 目前最大上下文窗口:约 100 万 token(但这不是甜点区)

- 甜点区:10–20 万 token——超过这个区间就会出现遗忘和遗漏

- Token 包含很多看不见的部分:思维链、中间处理过程、每个 Skill 的占用

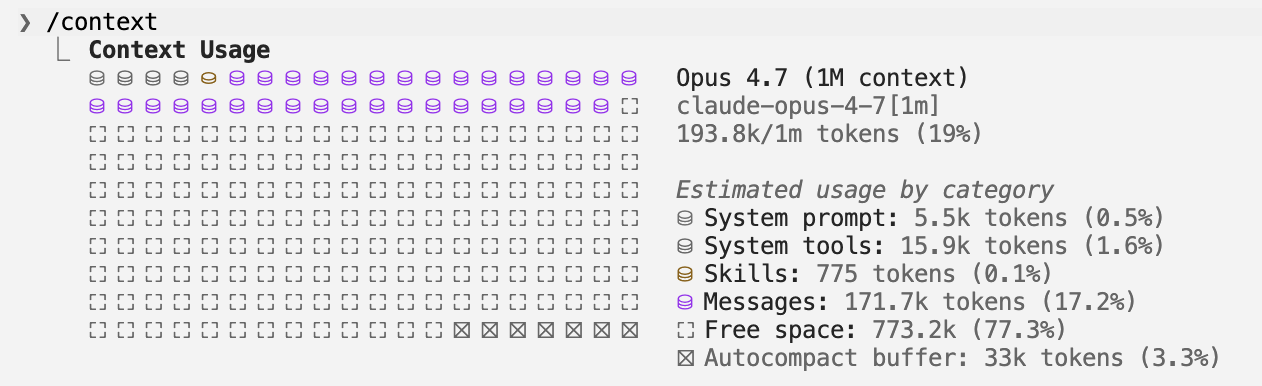

真正的 Token 使用情况,可以通过 /context 命令查看:

在 Codex App 中,点击左上角会话信息即可查看当前上下文用量和剩余额度。

在 Claude Code 运行过程中输入 /context 命令,即可查看当前 token 使用情况和各模块占比。

/context 命令)上下文管理要点

- 时刻关注上下文大小——超出承受区间就要压缩(Codex 和 Claude Code 都有压缩指令)

- 新任务新对话——如果要开始一个全新任务,新开一个对话或用

clear命令 - 用分支对话——把不在主线的问题放到分支,不占用主线的上下文

Codex App 中可以长按某条消息创建分支,分支对话独立于主线,不会占用主对话的上下文。

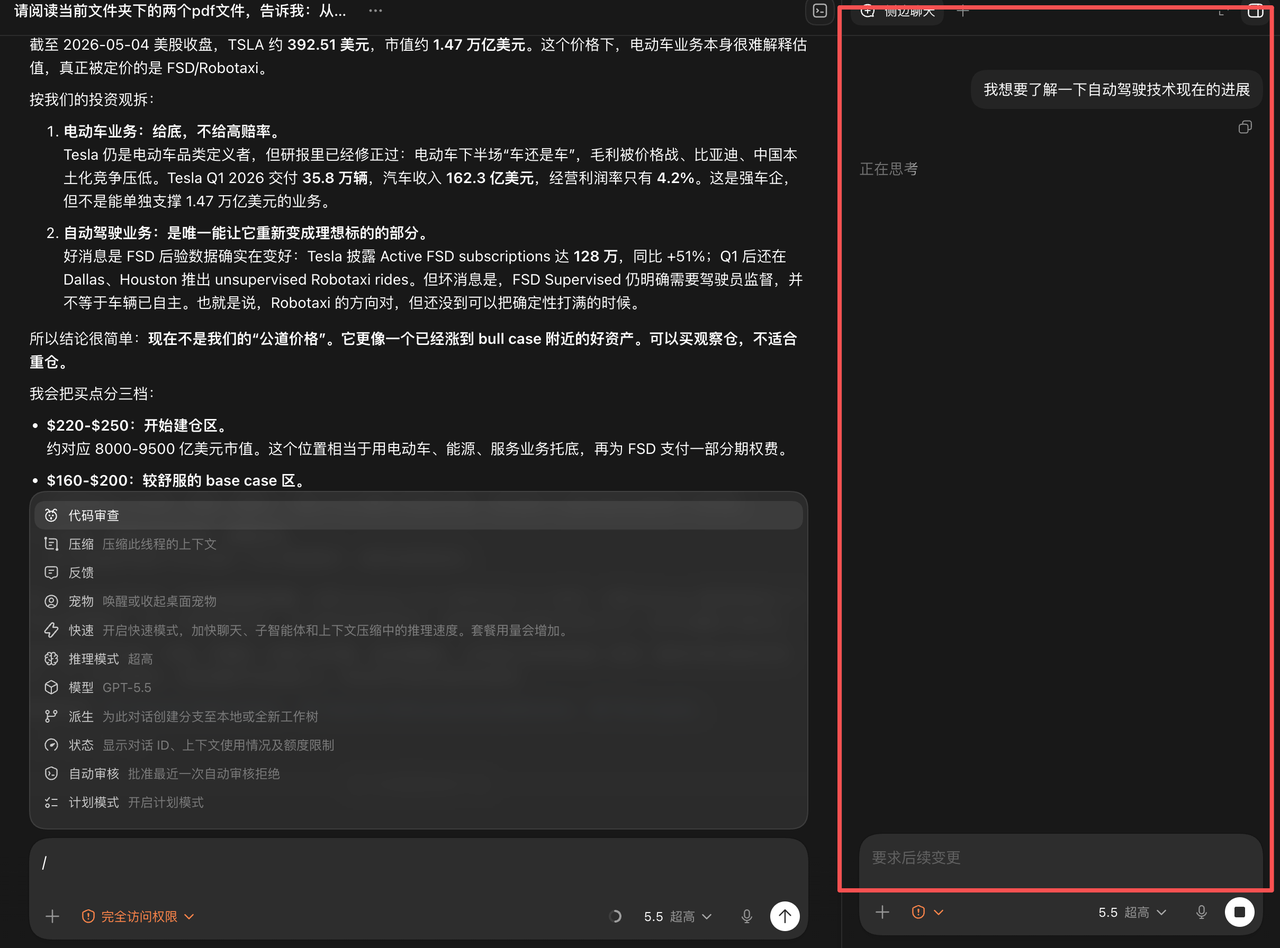

Claude Code 中输入 /btw 即可开启一个分支对话,处理旁支问题而不污染主线上下文。

/btw 开启分支对话,不占用主线上下文5法则三:构建反馈闭环

构建反馈闭环

执行任何任务时都要考虑:能不能构建出一个可观测的结果,让 AI 自己去观察自己的输出,然后自己去优化。有反馈闭环和没有反馈闭环,精准率差距可达 30%。

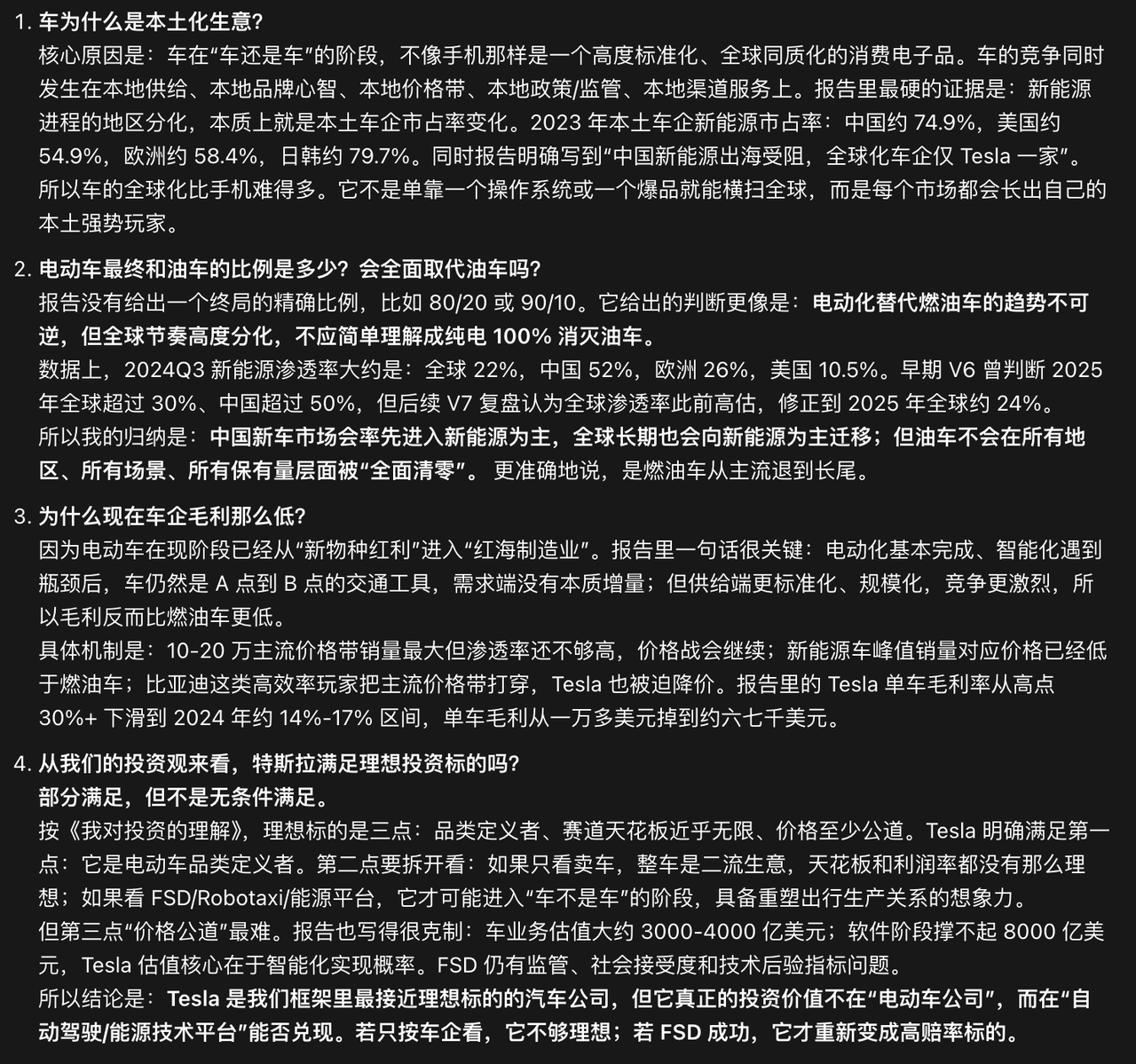

对比:有无反馈闭环的差异

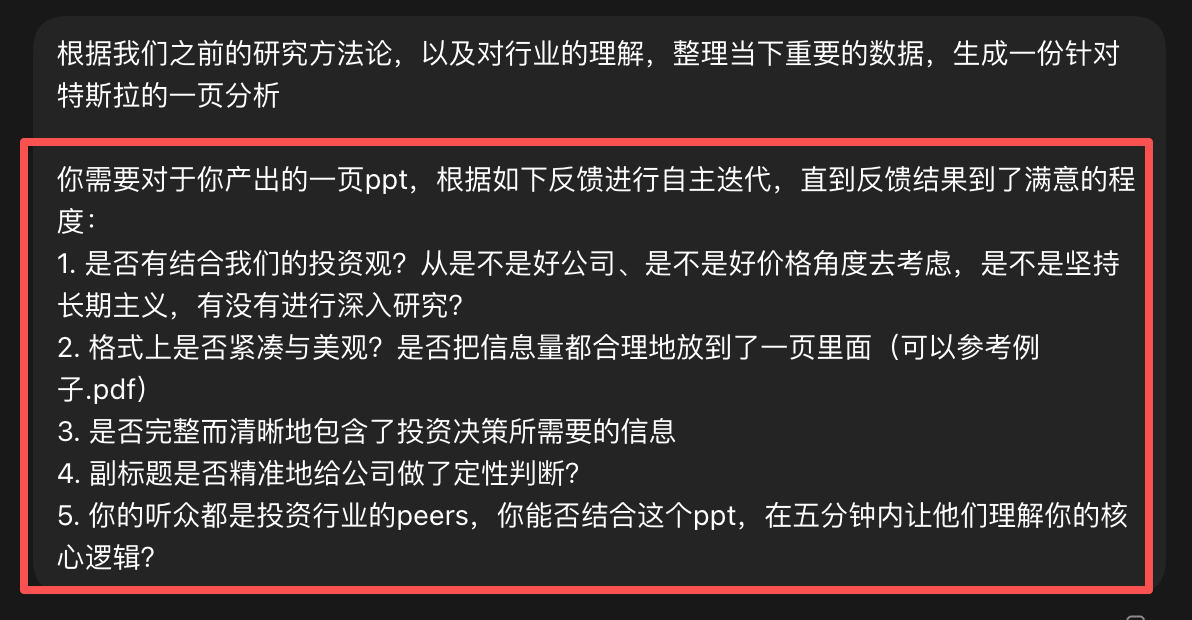

直接让 AI 生成一页分析报告。看起来还可以,但内容不深入、格式不符合要求。

给出明确的评价标准,让 AI 自己看自己的产出并自我迭代。结果质量大幅提升。

如何构建反馈闭环?

- 让结果可观测——让任务的产出能用简洁形式呈现:一页图片、一个 Markdown 文档、一个前端界面、一个可测量的指标……Agent 必须能"看到"自己做了什么

- 给定客观标准——给 Agent 一套无歧义的评价标准,让它能判断自己做得好不好。比如:"内容是否深入?格式是否符合模板?是否包含了关键数据?"

然后在 Prompt 中要求它反复迭代即可——这个过程可能需要较长时间,但产出质量会有质的飞跃。

6总结与思考

三个法则

- 对你要做的事建立概念——AI 产出的精确性,来源于你对概念理解的精确性

- 与你的 Coding Agent 同步——让 Agent 理解你的语境,也理解 Agent 的上下文

- 构建反馈闭环——让 AI 能观测自己的输出,并按客观标准自我迭代

| 法则 | 适合的 Skill | 技术与交付物 |

|---|---|---|

| 建立概念 | Grill Me | 先让 Agent 追问目标、边界、关键路径和评价标准;把模糊需求沉淀成 brief.md、任务拆解、数据口径、领域术语表或流程图,再进入执行。 |

| 同步语境 | Ubiquitous Language / Explore Mode | 把资料、方法论、示例产出放进项目目录;用 Markdown 文档、CLAUDE.md/AGENTS.md、上下文索引、分支对话和检查问题,让 Agent 先读懂你,再开始干活。 |

| 反馈闭环 | / | 让结果可被机器检查:网页用浏览器截图和控制台检查,代码用单元测试和 lint,文档/PPT 用渲染图复核,数据分析用指标校验;把检查标准写成清单,让 Agent 反复观察、修正、再验证。 |

思考题

- Coding 能否泛化到一切有确定产出的任务上?

- 人与 Coding Agent 最理想的协作关系是什么样的?

- 传统的软件还有存在的意义吗?

7参考资料

Coding Agent 最佳实践

Coding Agent 运作原理

延伸阅读 & 视频

相关论文

- arXiv · 2210.03629 — ReAct: Synergizing Reasoning and Acting

- arXiv · 2303.17580 — HuggingGPT: Solving AI Tasks with LLMs

- arXiv · 2302.04761 — Toolformer: Language Models Can Teach Themselves to Use Tools

- arXiv · 2303.11366 — Reflexion: Language Agents with Verbal Reinforcement Learning

- arXiv · 2305.16291 — Voyager: An Open-Ended Embodied Agent with Large Language Models

- arXiv · 2506.19290 — Agent Coding 相关研究